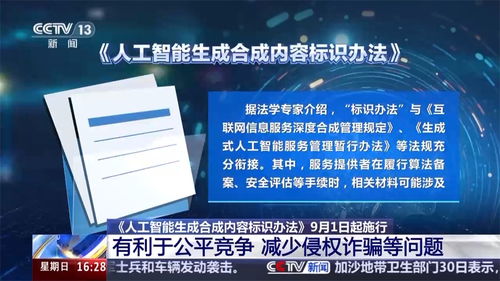

隨著人工智能技術的飛速發展,AI生成內容在互聯網信息傳播中扮演著越來越重要的角色。這也帶來了內容真實性模糊、誤導用戶等問題。為了規范互聯網信息服務,自今年9月1日起,中國相關部門發布新規,要求內容創作者在發布AI生成的內容時必須明確標識其來源,即必須“亮明身份”。這一規定旨在增強信息透明度,保護用戶權益。

新規覆蓋了文本、圖像、音頻和視頻等多種形式的AI生成內容。根據要求,創作者需在內容發布時以清晰方式標注“AI生成”或類似標識,避免用戶誤以為是人工創作。這一舉措不僅有助于用戶辨別信息真偽,還能促進內容產業的健康發展,鼓勵原創和高質量創作。

實施這一規定后,互聯網信息服務提供者也需承擔相應責任,加強平臺審核機制。違反規定的行為可能面臨警告、罰款甚至暫停服務等處罰。專家表示,此舉是應對AI技術風險的重要一步,未來或需進一步完善相關法律框架。9月1日的新規標志著AI內容管理進入新階段,呼吁所有創作者和平臺積極遵守,共建清朗網絡空間。